Warum wir über Prompt Engineering sprechen

Bei Beaufort entwickeln wir KI-Agenten, die reale Geschäftsprozesse Ende-zu-Ende unterstützen. Damit diese Agenten zuverlässig arbeiten, brauchen sie präzise Eingaben und klare Vorgaben. Genau dort liegt unsere tägliche Praxis als Prompt-Profis: Wir formulieren Prompts so, dass Ergebnisse konsistent, nachvollziehbar und produktiv einsetzbar sind – in Fachbereichen von Compliance über Operations bis Kommunikation.

Dieses Wissen wollen wir mit dir teilen – praxisnah wie in einem Prompt Engineering Kurs. Heute geht es um einen der wirkungsvollsten Hebel: Beispiele.

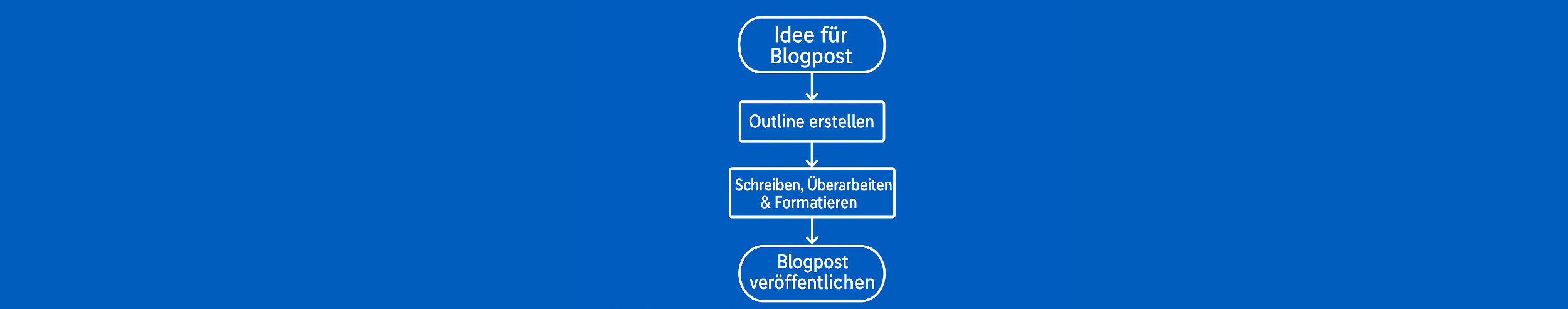

Beispiele als Turbo für bessere Antworten

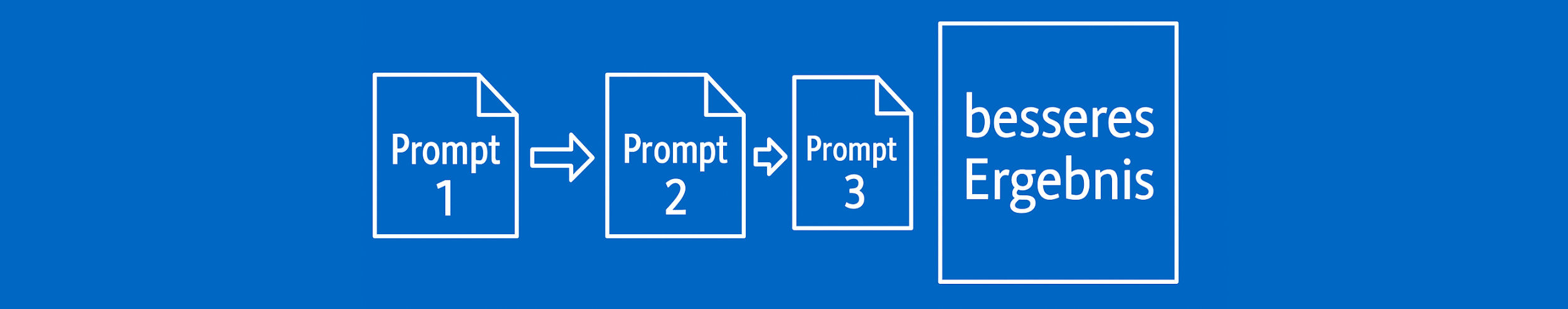

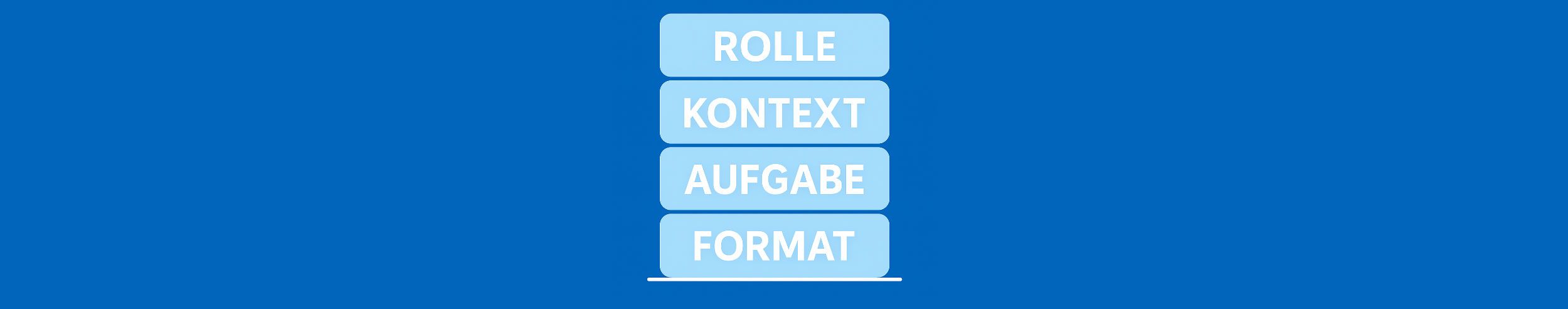

In den bisherigen Teilen hast du die Struktur eines stabilen Prompts kennengelernt: Rolle, Kontext, Aufgabe und Format. Jetzt kommt ein Baustein dazu, der die Qualität spürbar hebt und die Streuung verringert. Wenn du dem Modell ein oder mehrere Beispiele gibst, zeigst du nicht nur, was du willst, sondern wie es klingen, aussehen und aufgebaut sein soll. Dieses Vorgehen wird oft Few-Shot Prompting genannt. Im Kern ist es simpel: Du reichst eine kurze Vorlage mit, an der sich das Modell orientieren kann.

Ohne Beispiel entscheidet das Modell selbst, welchen Stil und welche Tiefe es wählt. Mit Beispiel verschiebst du diese Entscheidung an den Anfang und begrenzt den Suchraum. Das Resultat wirkt näher an deinem Ton, deiner Struktur und deinem Qualitätsmassstab. Gerade bei Textsorten mit hoher Erwartung an Stil und Haltung – Einladungen, Medienmitteilungen, HR-Notizen, Kundenbriefe – zahlt sich das sofort aus.

Die Analogie, die alles erklärt

andere legen einen Cha-Cha hin. Sagst du stattdessen: „Schau dir dieses kurze Video von Flamenco-Tänzerinnen und Tänzern an – bitte tanz jetzt so“, dann rückt die Ausführung plötzlich eng an deine Erwartung heran. Genau so reagiert ein Sprachmodell auf Beispiele. Ein neutrales „Tanz mal“ lässt zu viel Raum. Ein konkretes Beispiel macht die Anforderung greifbar.

Übertragen auf Texte bedeutet das: Wenn du höfliche, klare Sprache ohne Fremdwörter brauchst, dann zeig ein Stück Text, das genau das vorlebt. Wenn du eine nüchterne, distanzierte Tonalität willst, liefere ein kurzes Muster, das diese Distanz trägt. Das Modell nimmt solche Hinweise ernst und richtet seine Wahrscheinlichkeiten an deinem Beispiel aus.

Wie Beispiele die Varianz technisch verkleinern

Ein Sprachmodell erzeugt Antworten, indem es Wort für Wort das wahrscheinlich nächste Wort wählt. Diese Wahrscheinlichkeiten hängen stark vom Kontext ab. Ein Beispiel wirkt wie eine zusätzliche Gewichtsverteilung: Es verschiebt die Wahrscheinlichkeiten in Richtung des gezeigten Musters. Das heisst nicht, dass zwei Durchläufe identisch werden. Aber die Streuung verengt sich rund um eine Mitte, die deinem Stil, deiner Struktur und deiner Tiefe entspricht.

Aus höflich-beliebigen Texten werden wiedererkennbare Entwürfe, die schneller freigegeben werden können. Damit wird ChatGPT im Alltag effizienter und planbarer.

Gute Beispiele auswählen – knapp, sauber, passend

Ein gutes Beispiel ist kurz genug, um den Prompt nicht zu überladen, und lang genug, um Ton, Aufbau und Dichte erkennbar zu machen. Ein bis drei Absätze reichen oft. Wähle Material, das du wirklich vertreten willst. Ein halbgutes Muster produziert halbgute Ableitungen. Achte darauf, dass dein Beispiel die Zielgruppe spiegelt, für die der neue Text gedacht ist.

Hilfreich ist eine klare Einbettung. Sag dem Modell ausdrücklich, dass es sich am Beispiel orientieren soll, ohne es zu kopieren. Verlange ähnliche Tonalität, vergleichbare Struktur und passende Länge, aber keine Wiederholung von Formulierungen. So vermeidest du Wiederkäuen und bekommst trotzdem die gewünschte Nähe.

Beispiele einbinden, ohne den Prompt zu überfrachten

Beispiele wirken am besten, wenn sie sauber an Rolle, Kontext, Aufgabe und Format andocken. Zuerst legst du fest, wer spricht und wofür der Text gilt. Dann kommt die Arbeitsanweisung. Anschliessend nennst du die wichtigsten Einschränkungen, etwa „klares Deutsch, keine Anglizismen, keine Aufzählungen“. Direkt danach fügst du das Beispiel ein und erklärst in einem Satz, wozu es dient. So bleibt die Logik deines Prompts intakt, und das Modell kann den roten Faden aufnehmen.

Wenn dein Beispiel länger ist, arbeite mit einem Auszug. Schreibe davor, dass nur Ton und Aufbau als Referenz dienen. Wenn du Quellenmaterial anhängst – etwa ein internes Stilkapitel oder eine veröffentlichte Notiz, die exakt den Ton trifft –, reicht oft ein markierter Abschnitt, der die Essenz transportiert.

Stil, Aufbau und Dichte gezielt übertragen

Beispiele sind nicht nur Stil-Schablonen. Sie helfen auch, Struktur und Informationsdichte zu steuern. Wenn dein Muster mit kurzer Einleitung beginnt, danach zwei dichte Absätze bringt und am Ende eine knappe Empfehlung steht, übernimmt das Modell diese Dramaturgie.

Wenn dein Beispiel sichtbar ohne Fachjargon auskommt und Begriffe erst einführt, wenn sie gebraucht werden, wird es diese Praxis eher fortführen. Je klarer das Muster, desto zuverlässiger die Übertragung.

Bei kreativeren Aufgaben – etwa einem Ideenpapier – lohnt sich ein Beispiel, das die gewünschte Balance aus Originalität und Bodenhaftung zeigt. Brauchst du fünf solide Ansätze statt einer schillernden Vision, dann liefere ein Muster, das solide, aber pragmatisch vorgeht. Das Modell liest diese Haltung mit.

Grenzen, die du kennen solltest

Beispiele sind mächtig, aber kein Allheilmittel. Ein unpassendes Muster lenkt Antworten in die falsche Richtung. Zu viele Beispiele verwirren. Widersprüchliche Vorlagen führen zu Kompromissen, die niemanden glücklich machen.

Halte dich an wenige, starke Beispiele, die klar zu Rolle, Kontext und Aufgabe passen. Und achte darauf, dass dein Beispiel rechtlich unbedenklich ist, wenn du externes Material nutzt. Für interne Standards eignen sich eigene Texte oder explizit freigegebene Auszüge.

Wenn du merkst, dass das Modell einzelne Phrasen wörtlich übernimmt, weise es darauf hin, sinngemäss zu arbeiten. Bitte um eigenständige Formulierungen in der Tonalität des Beispiels. So sicherst du Originalität bei gleichzeitig stabiler Anmutung.

Vom Einzelbeispiel zur Bibliothek

Was einmal gut funktioniert, solltest du sichern. Lege eine kleine Sammlung geprüfter Beispiele an: je ein kurzes Muster für interne Mitteilungen, Kundenbriefe, Entscheidungsnotizen, Blog-Anrisse. Versioniere diese Sammlung und notiere, wofür jedes Beispiel taugt und wofür nicht.

Wenn Rolle und typische Kontexte in deinen Assistenten bereits hinterlegt sind, kannst du pro Aufgabe ein passendes Beispiel andocken und erhältst im ersten Wurf nutzbare Qualität. Mit der Zeit entsteht eine leichte Bibliothek, die dein Team teilt. Neue Kolleginnen und Kollegen kommen schneller auf Linie, weil Ton und Aufbau nicht mehr mühsam erklärt werden müssen, sondern erlebbar sind.

Weiterbildung: Prompt Engineering Kurs

In dieser Videoreihe erklären wir die wichtigsten Prinzipien Schritt für Schritt und zeigen, warum sie technisch tragen. Ziel: dass Nutzerinnen und Nutzer mit wenig Aufwand bessere, stabilere Resultate erzielen.

Wer tiefer einsteigen will, findet in unserem Weiterbildungsangebot mit der ZHAW ein kompaktes Format:

Prompt Engineering: ChatGPT und andere KIs lernen und produktiv einsetzen.

Der Kurs vermittelt praxisnahes Prompt Design, zeigt Prompt Templates mit ChatGPT Beispielen und macht KI im Alltag direkt anwendbar.

Mehr dazu im Video und auf der Prompting-Landingpage

Mehr Details dazu auch in diesem Video.

Zusätzlich haben wir eine Übersichtsseite über Prompt-Engineering eingerichtet.

Trage dich auch unten auf der Seite in den Newsletter ein, es erscheinen hier in den nächsten Wochen viele weitere Videos zum Thema “Prompt Engineering”.